Quand l’innovation soulève des inquiétudes

L’intelligence artificielle est souvent présentée comme une promesse d’innovation et d’efficacité. Elle alimente la créativité, facilite la personnalisation des campagnes et ouvre la voie à des expériences immersives inédites. Pourtant, derrière cet enthousiasme, se cachent des dérives inquiétantes. Les deepfakes et les manipulations visuelles, rendus accessibles par des technologies de plus en plus sophistiquées, posent des questions majeures de confiance, d’éthique et de responsabilité.

Alors que les marques cherchent à intégrer l’IA dans leur stratégie, elles doivent aussi mesurer les risques liés à ces usages détournés, qui peuvent fragiliser leur réputation et miner le lien de confiance avec les consommateurs.

Deepfakes : la frontière floue entre réel et fiction

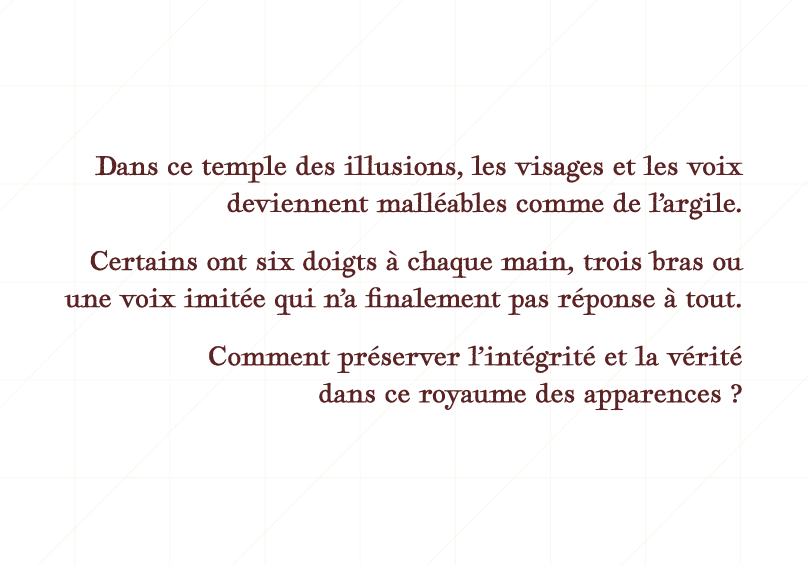

Les deepfakes sont devenus l’exemple le plus médiatisé des dérives de l’IA. Ces vidéos hyperréalistes, générées par des réseaux neuronaux, permettent de remplacer un visage ou une voix par un autre avec une précision troublante.

Au départ, cette technologie pouvait sembler ludique ou créative. Mais son utilisation abusive a rapidement pris de l’ampleur. Des personnalités publiques ont vu leur image manipulée pour diffuser de fausses informations, tandis que des particuliers ont été victimes de contenus malveillants, parfois à caractère diffamatoire ou intime.

Pour les marques, le danger est double : elles peuvent devenir la cible de campagnes de désinformation, ou voir leur identité détournée dans des contenus trompeurs. La frontière entre communication officielle et contenu falsifié devient alors extrêmement difficile à tracer.

Manipulations visuelles : un pouvoir amplifié par l’IA

Au-delà des deepfakes, l’IA facilite des manipulations visuelles plus subtiles. Des photos retouchées automatiquement, des publicités altérées en temps réel ou des messages adaptés à chaque audience peuvent créer une réalité parallèle difficile à distinguer de la vérité.

Cette capacité à modifier des images ou des vidéos en quelques clics soulève des enjeux considérables. Dans un monde saturé de contenus, le consommateur moyen ne dispose ni du temps ni des compétences pour analyser la véracité d’une information. Cela renforce la vulnérabilité face aux fake news, aux campagnes politiques manipulatrices ou aux messages commerciaux trompeurs.

Si ces techniques offrent aux marques un pouvoir créatif inédit, elles comportent aussi une responsabilité accrue. Utilisées sans transparence, elles risquent d’éroder la confiance du public et d’alimenter un climat de suspicion généralisée.

Impact sur la confiance et la crédibilité

L’authenticité est devenue une valeur centrale dans la communication moderne. Les consommateurs, en particulier les jeunes générations, recherchent des marques transparentes, capables de démontrer leur sincérité et leur engagement.

Les dérives de l’IA fragilisent directement cette quête de confiance. Un simple doute sur la véracité d’un contenu peut suffire à affaiblir la crédibilité d’une campagne entière. De plus, les scandales liés à l’utilisation abusive des deepfakes ou des images manipulées se propagent rapidement sur les réseaux sociaux, avec des conséquences parfois désastreuses pour l’image de marque.

Dans ce contexte, les entreprises doivent redoubler de vigilance. La question n’est pas seulement de savoir comment utiliser l’IA pour innover, mais aussi comment prévenir les abus et protéger leur capital confiance.

Vers une régulation et une éthique de l’IA

Face à ces dérives, la régulation progresse lentement mais sûrement. L’Union européenne, avec son projet de règlement sur l’intelligence artificielle, cherche à encadrer les usages les plus risqués. Plusieurs plateformes sociales mettent également en place des systèmes de détection des deepfakes et des contenus manipulés.

Mais la régulation seule ne suffira pas. Les marques et les agences doivent elles-mêmes développer une charte éthique claire pour encadrer leurs pratiques. Cela passe par la transparence des messages, l’éducation des publics à la lecture critique des contenus, et le refus d’exploiter des manipulations susceptibles d’induire en erreur.

Des usages positifs malgré les dérives

Il serait réducteur de considérer l’IA visuelle uniquement sous l’angle de ses abus. Les mêmes technologies qui permettent de créer des deepfakes peuvent aussi être mises au service de la créativité et de l’innovation. Des films exploitent ces outils pour repousser les limites de la narration, des campagnes publicitaires utilisent la personnalisation visuelle pour améliorer l’expérience client, et des musées s’en servent pour redonner vie à des archives ou des personnages historiques.

La clé réside dans la transparence et dans le contexte d’utilisation. Une technologie n’est ni bonne ni mauvaise par nature : tout dépend de l’intention et de l’éthique de ceux qui la déploient.

Innovation sous surveillance

Les deepfakes et les manipulations visuelles incarnent le paradoxe de l’intelligence artificielle : une puissance créative fascinante, mais aussi un potentiel de dérives préoccupant. Pour les marques comme pour les institutions, l’enjeu est clair : innover tout en restant garantes de la confiance.

Le futur du marketing et de la communication passera par une double vigilance : adopter les technologies d’IA pour enrichir les expériences, tout en imposant des garde-fous pour éviter les abus. Seules les entreprises capables de conjuguer innovation et responsabilité sauront tirer parti de cette révolution sans perdre l’essentiel : la crédibilité et l’authenticité.